Onderzoekers van de Chinese Universiteit van Zheijiang hebben iets heel interessants ontdekt, namelijk dat intelligente assistenten in mobiele telefoons (in dit geval Siri en Alexa) op een heel eenvoudige manier kunnen worden aangevallen zonder dat de eigenaar van het aangevallen apparaat daar enig idee van heeft. Echogeleide aanvallen zijn voor het menselijk oor onhoorbaar, maar de microfoon in uw apparaat kan ze detecteren en, zo blijkt, in veel gevallen ook kunnen worden aangestuurd.

Het zou kunnen interesseer je

Deze aanvalsmethode heet "DolphinAttack" en werkt volgens een heel eenvoudig principe. Ten eerste is het nodig om menselijke stemcommando's om te zetten in ultrasone frequenties (band 20 Hz en hoger) en deze commando's vervolgens naar het beoogde apparaat te sturen. Het enige dat nodig is voor een succesvolle geluidsoverdracht is een telefoonluidspreker die is aangesloten op een kleine versterker en een ultrasone decoder. Dankzij de gevoelige microfoon in het aangevallen apparaat worden de commando's herkend en neemt de telefoon/tablet ze op als klassieke spraakcommando's van de eigenaar.

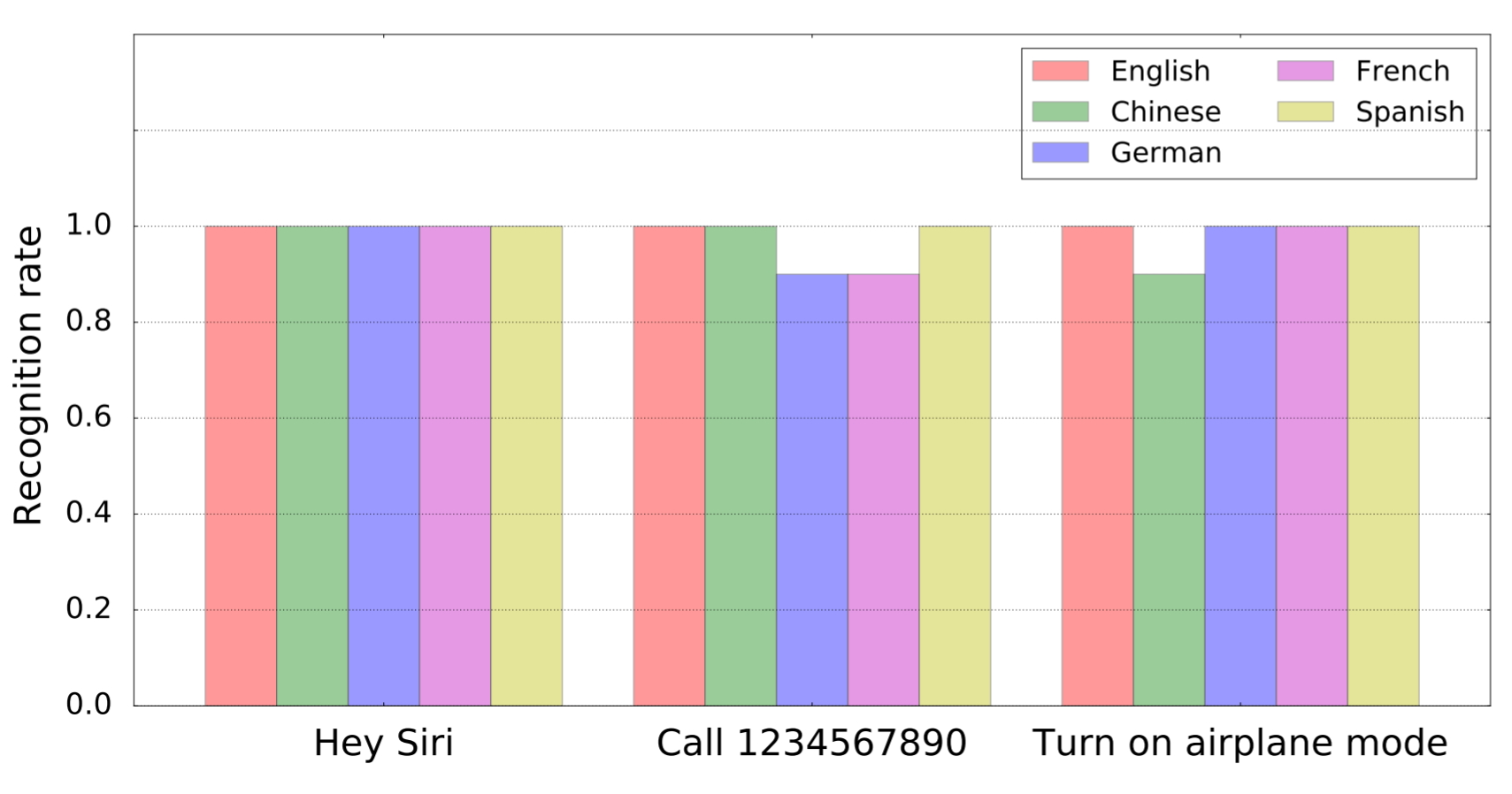

Uit het onderzoek bleek dat vrijwel alle vrouwelijke assistenten op de markt reageren op dergelijke aangepaste bestellingen. Of het nu Siri, Alexa, Google Assistant of Samsung S Voice is. Het geteste apparaat had geen invloed op het testresultaat. De reactie van de assistenten kwam dus zowel via de telefoon als via een tablet of computer binnen. Concreet werden iPhones, iPads, MacBooks, Google Nexus 7, Amazon Echo en zelfs Audi Q3 getest. In totaal waren er 16 apparaten en 7 verschillende systemen. Echocommando's werden door iedereen geregistreerd. Wat wellicht nog griezeliger is, is het feit dat de gewijzigde (en voor het menselijk oor onhoorbare) commando’s ook door de spraakherkenningsfunctie werden herkend.

Bij de tests zijn verschillende procedures gebruikt. Van een eenvoudige opdracht om een nummer te bellen, tot het openen van een gedicteerde pagina of het wijzigen van specifieke instellingen. Als onderdeel van de test was het zelfs mogelijk om de bestemming van de navigatie van de auto te wijzigen.

Het enige positieve nieuws over deze nieuwe manier om het apparaat te hacken is het feit dat het momenteel op zo’n anderhalf tot twee meter werkt. Verdediging zal moeilijk zijn, omdat de ontwikkelaars van stemassistenten de frequenties van de waargenomen commando's niet willen beperken, omdat dit zou kunnen leiden tot een slechtere werking van het hele systeem. In de toekomst zal er echter een oplossing moeten worden gevonden.

Bron: Engadget

Omdat u het artikel vertaalt, had u het begrijpelijker kunnen maken. Vanaf het Engelse origineel is het veel minder verwarrend hoe het werkt. Verdediging is triviaal, negeer gewoon de commando's die alleen op ultrasone frequenties komen.

Ja, en zoals vermeld in het artikel zullen ontwikkelaars niet doorgaan met het negeren van opdrachten van ultrasone frequenties, omdat het niet helemaal duidelijk is hoe dit de resulterende kwaliteit en herkenningsmogelijkheden van klassieke spraakopdrachten zou beïnvloeden.

Nee, het artikel zegt dat we het spectrum moeten hakken. Ik stelde voor om de input, die alleen uit het ultrasone deel van het spectrum bestaat, te negeren.